云端部署OpenClaw:接入飞书生态,打造专属AI智能助手

在AI自动化工具高速发展的今天,OpenClaw作为一款开源AI代理与自动化平台,正以其出色的灵活性和兼容性,成为许多人打造专属智能助手的优选方案。它支持通过自然语言指令操控设备、处理各类自动化任务,并能无缝适配Qwen、Claude、GPT等主流大语言模型,让复杂任务的调度变得简单直观。过去,部署此类工具常涉及繁琐的环境配置,对普通用户门槛较高。如今,借助大模型实验室可以让更多非技术用户也能轻松上手,快速构建专属Agent。

大模型实验室是一个开放共享的内容社区平台,支持按需自定义创建GPU和CPU实例,用户可一键启动符合业务需求的计算资源。其高性能GPU算力满足高精度推理与训练需求,同时提供“JupyterLab”和“VS Code”等开发环境,方便用户利用CPU/GPU实例进行数据预处理与模型调试,全面提升大模型应用开发效率。

前提条件

- 用户已经获取大模型实验室平台账户和密码,如果需要帮助或尚未注册,可参考注册账户完成注册。

- 当前账号的余额充裕,可满足实例运行的需要。点击可了解费用信息。

- 如果您调用Baicai Infer(白菜AIGC)API,需保证当前账户余额充足以满足推理要求。

操作步骤

配置概览

| 参数 | 配置项 | 说明 |

|---|---|---|

| 模型 | Qwen3-30B-A3B-Instruct-2507-FP8 | Qwen3-30B-A3B-Instruct-2507-FP8是300亿参数MoE模型,激活30亿,支持256K上下文,经指令微调并采用FP8量化,高效卓越。 |

| CPU | 4核 | 建议至少配置4核CPU资源。 |

脚本配置

-

使用已注册的大模型实验室账号登录平台,点击悬浮菜单栏的“文件管理”按钮,在

user-data目录下新建一个名为“openclaw”的文件夹,例如下图所示。

-

大模型实验室已预置OpenClaw应用脚本,启动CPU/GPU实例即可获取对应脚本,点击菜单栏[算力平台]菜单项或者悬浮菜单栏的“新建实例”按钮,选择VSCode图标,进入实例启动配置页面,例如下图所示。

-

选择CPU资源,卡数填写

4,其他参数保持为默认值,单击“启动”按钮,启动实例。

-

实例启动后,点击[New Terminal/Terminal]进入终端页面,在终端运行如下所示的命令打开预置的配置文件,切换到插入模式,开始编辑文本。

vim /root/.openclaw/openclaw.json信息vim有几种主要模式,最常用的是普通模式和插入模式。启动后,默认为普通模式。

- i:在光标前插入。

- a:在光标后插入。

- 按

Esc键可随时退出插入模式,返回普通模式。

- Baicai Infer(白菜AIGC)

- Alaya Code

- 自有模型

-

请将

openclaw.json脚本中的apiKey字段替换为您的Baicai Infer(白菜AIGC)推理API Key,以便调用平台已部署的 Qwen3-30B-A3B-Instruct-2507-FP8大模型服务。

-

您也可以通过Alaya Code接入主流模型,Alaya Code提供 OpenAI,Anthropic兼容接口,支持的模型列表请参考支持的模型,详细操作如下。

-

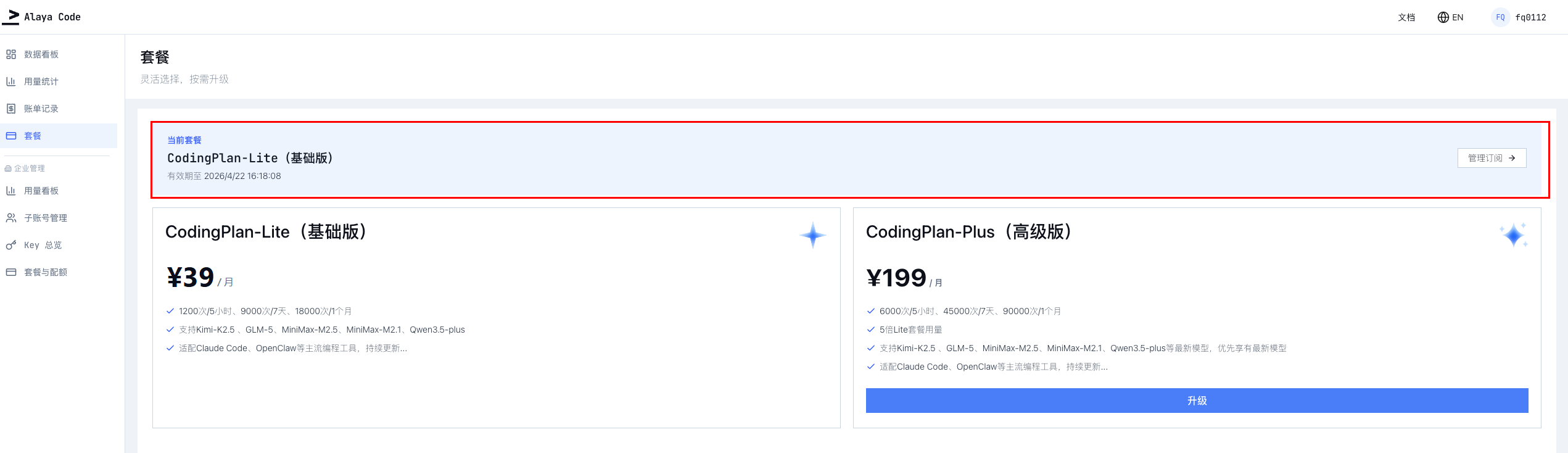

登录九章智算云平台,进入Alaya Code套餐页面,选择并订阅合适的套餐,本例订阅“CodingPlan-Lite(基础版)”,例如下图所示。

-

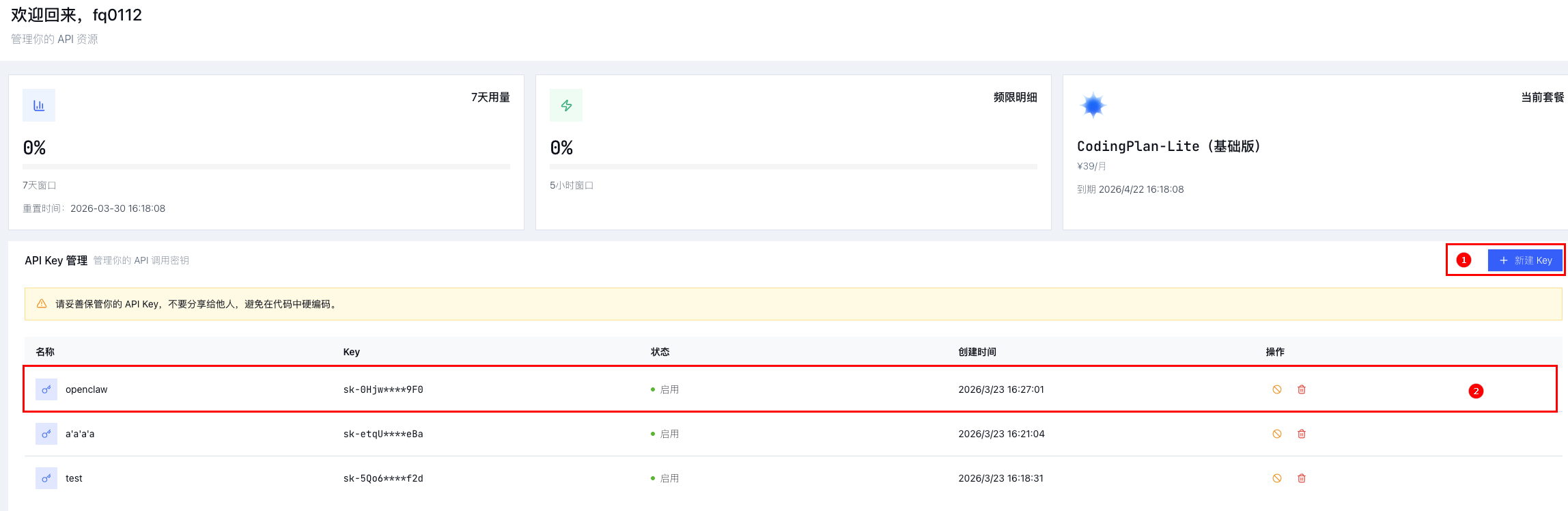

切换至[数据看板]菜单项,单击“新建Key”以创建模型访问秘钥,如下图所示。

-

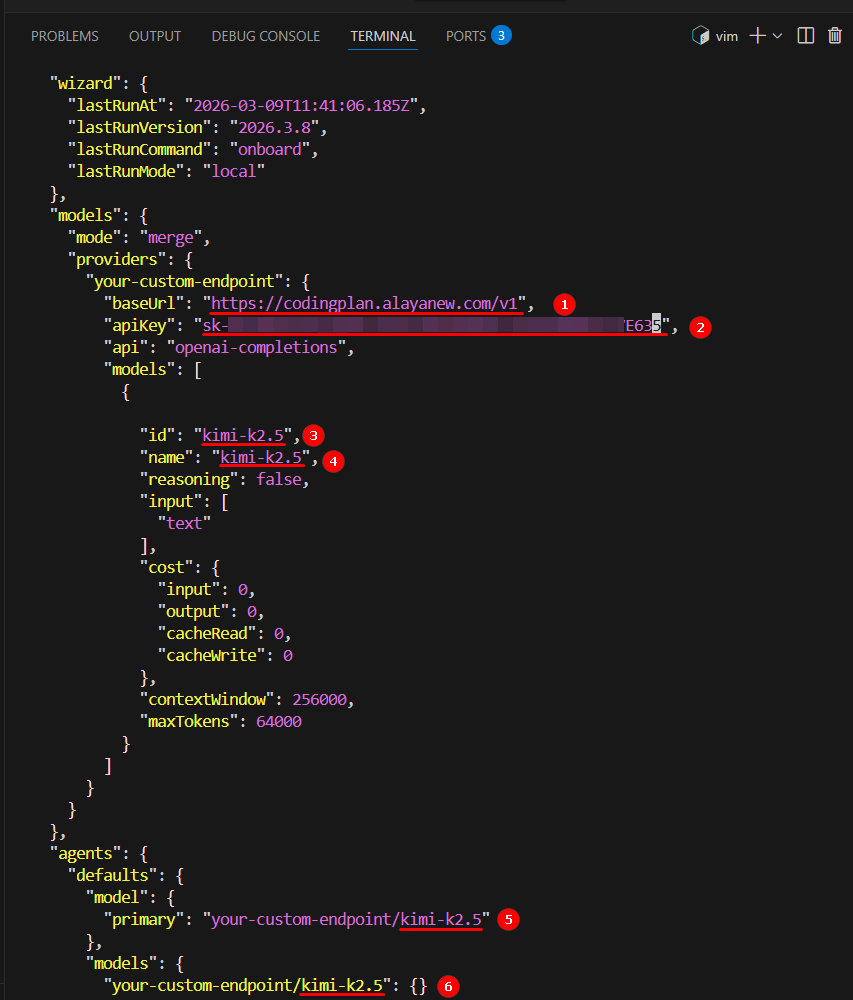

将

openclaw.json脚本文件中的相关字段替换为“CodingPlan-Lite”支持模型的对应参数,例如下图所示。-

baseUrl:替换为https://codingplan.alayanew.com,例如下图高亮①所示。 -

apiKey:替换为您订阅套餐后创建的API Key,创建页面可参考步骤ii,配置页面例如下图高亮②所示。 -

id:替换为“CodingPlan-Lite”支持模型的model参数,例如下图高亮③所示。更多参数请参考API文档。 -

name:替换为“CodingPlan-Lite”支持模型的服务名称,可自定义,建议与id关联,例如下图高亮④所示。 -

primary:将默认主模型配置为“CodingPlan-Lite”支持的模型,此处仅需将默认模型替换为支持的模型id,例如下图高亮⑤所示。 -

models:将待调用模型的Key,替换为“CodingPlan-Lite”支持的模型标识,须与primary中的值匹配,此处配置为模型id,例如下图高亮⑥所示。

-

-

-

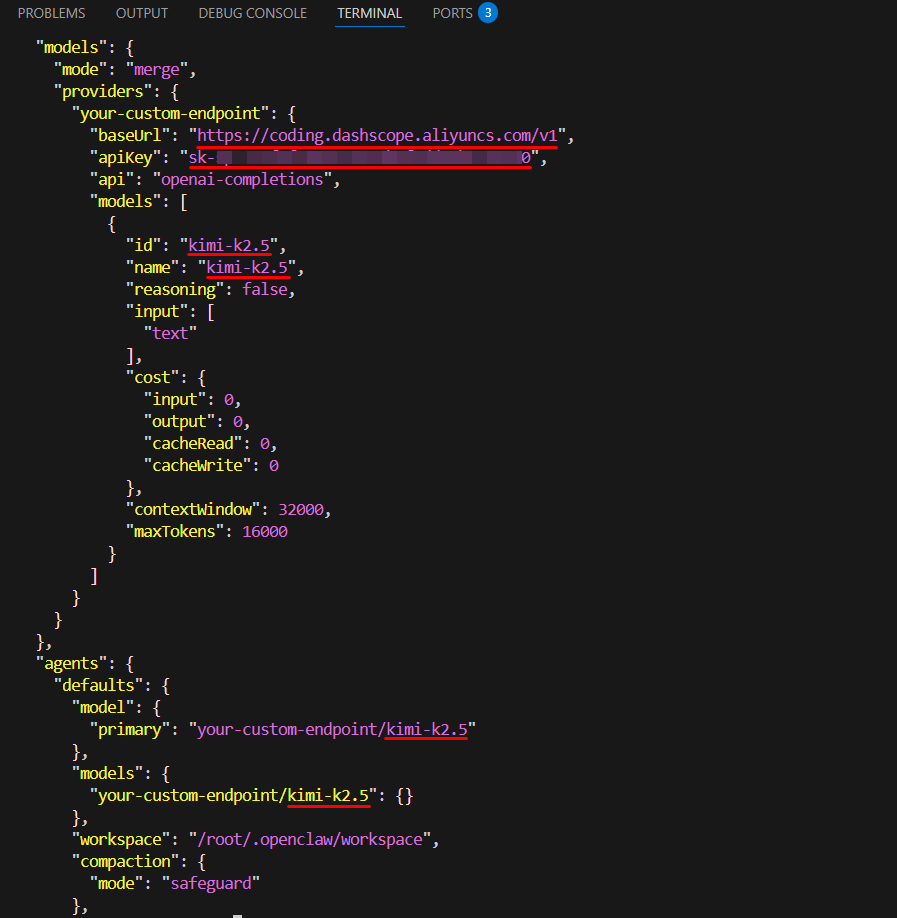

您也可以使用自有模型,将

openclaw.json脚本文件中的以下字段替换为自有模型的对应值,例如下图所示。-

baseUrl:替换为您自有模型的专属Base URL。 -

apiKey:替换为您自有模型的API Key,用于调用服务时做身份验证。 -

id:替换为您自有模型的model字段,如下图所示。 -

name:替换为您自定义的模型服务名称,可自定义,建议与id关联。 -

primary:将默认主模型配置为您自有的模型,此处仅需将默认模型替换为自有模型id。 -

models:将待调用模型的Key,替换为您自有模型的标识,须与primary中的值匹配,此处配置为自有模型id。 提示

提示若已调用某模型服务并需更换其他模型,请在参照上述步骤配置新模型参数后,重启OpenClaw服务,重启步骤可参考常见问题章节的“问题1:如何重启openclaw服务?”。

-

-

访问飞书开放平台,单击[创建企业自建应用],填写应用名称和描述,选择应用图标,单击“创建”按钮,例如下图所示。

-

单击左侧导航栏[凭证与基础信息]页签,在该页面复制

App ID和App Secret,例如下图所示。

-

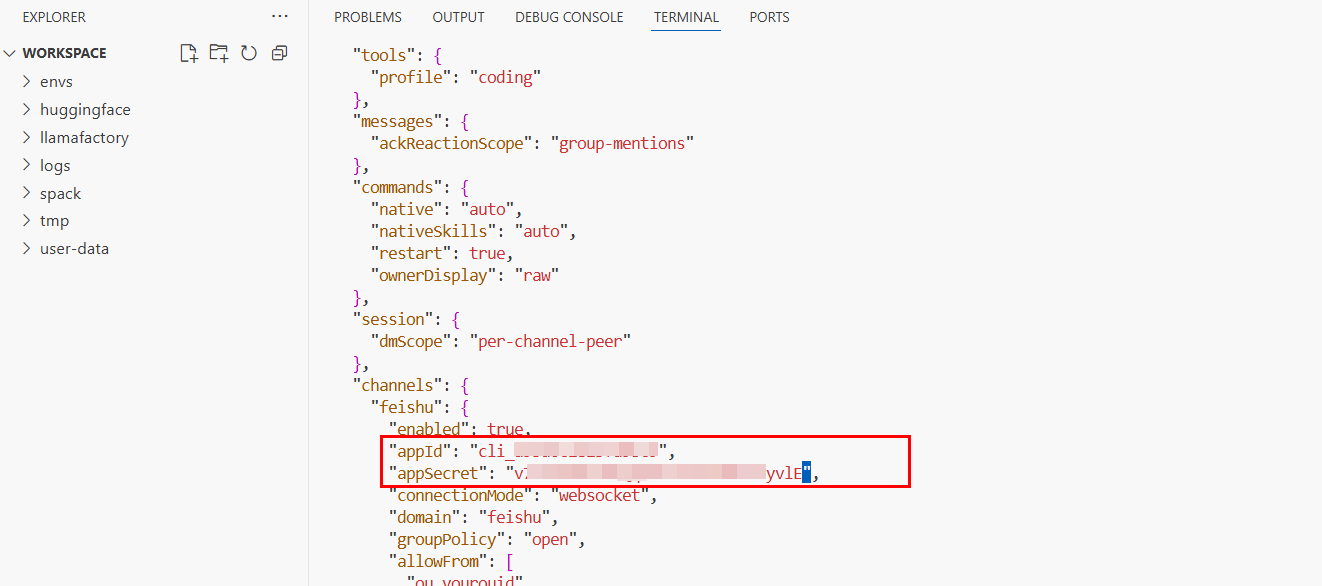

将

openclaw.json脚本中的appId、appSecret分别替换为您自己App ID和App Secret。

上述参数配置完成后,按 Esc 退出编辑模式,在英文输入法下输入:wq保存并退出,即可完成OpenClaw服务的脚本配置。

Web访问服务(可选)

上述配置保存完成后,如果您想通过WebUI页面访问OpenClaw服务,仅需做一下配置即可。

-

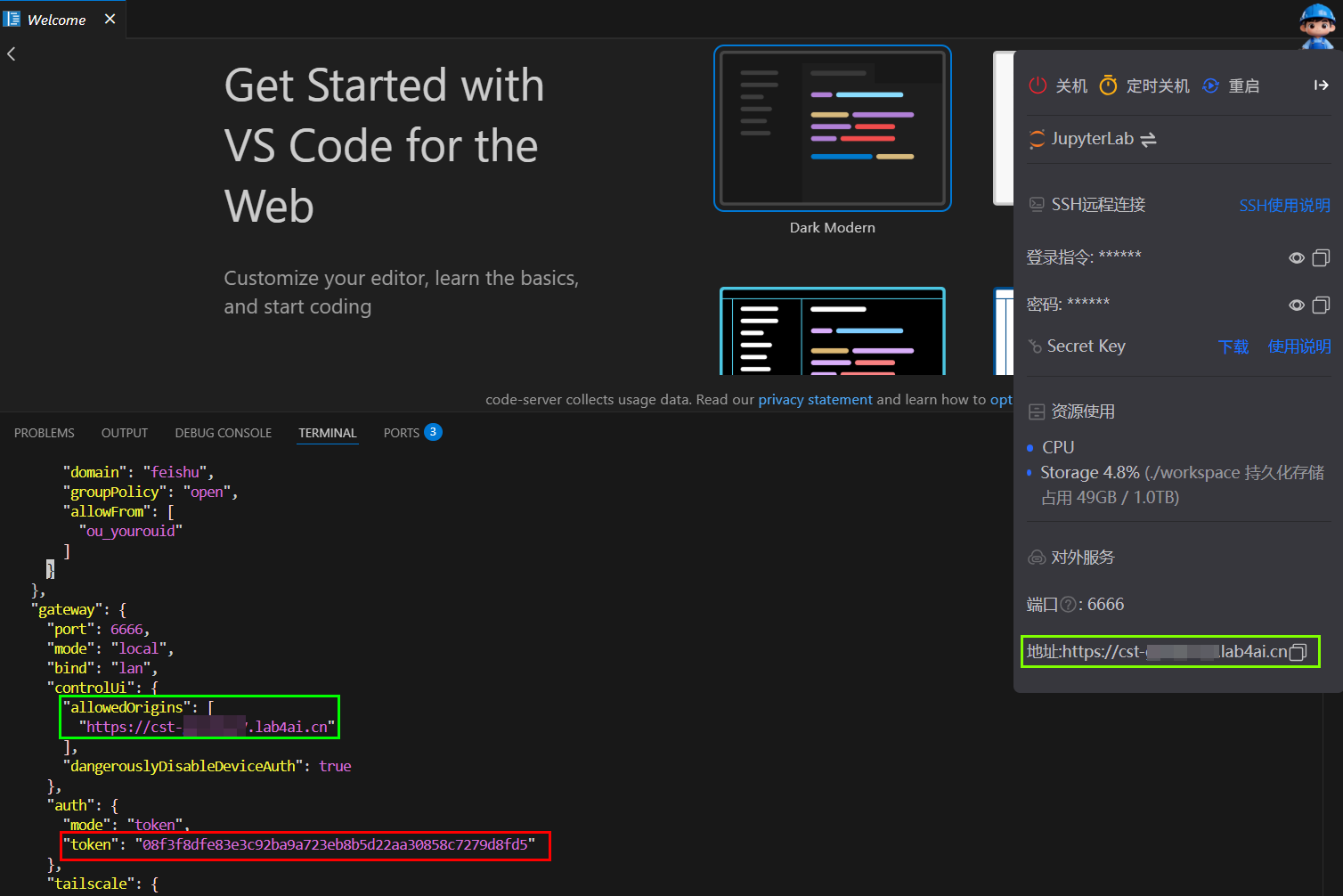

在

openclaw.json脚本文件中将allowedorigins字段修改为实例对外访问地址,例如下图绿色高亮所示。

-

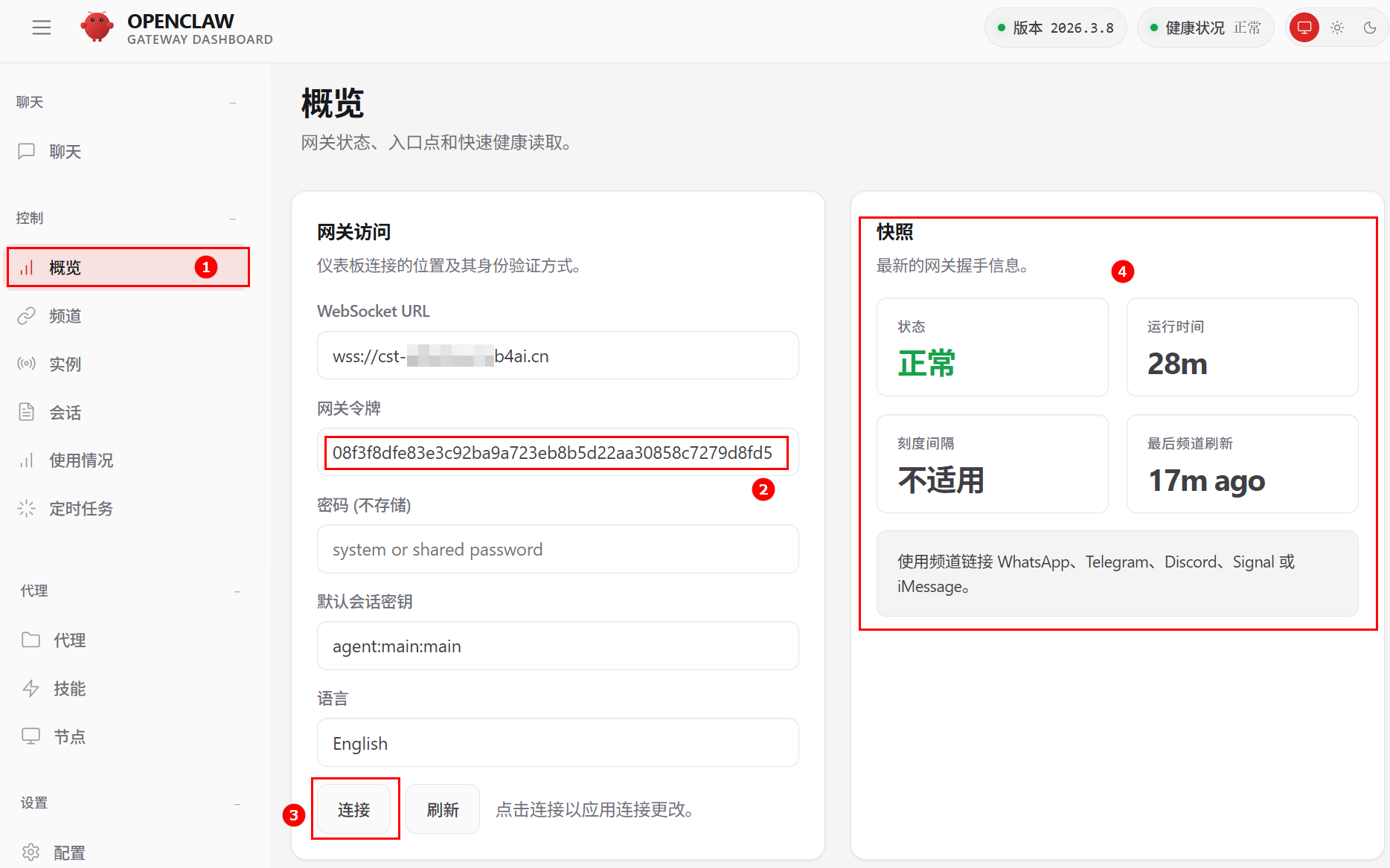

在浏览器中打开实例访问地址,切换至[概览]页签,将网关令牌替换为上述红色高亮显示的

token值(08f3f8dfe83e3c92ba9a723eb8b5d22aa30858c7279d8fd5),随后单击“连接”。若网关握手状态显示正常,即表示该服务可正常访问,例如下图所示。

-

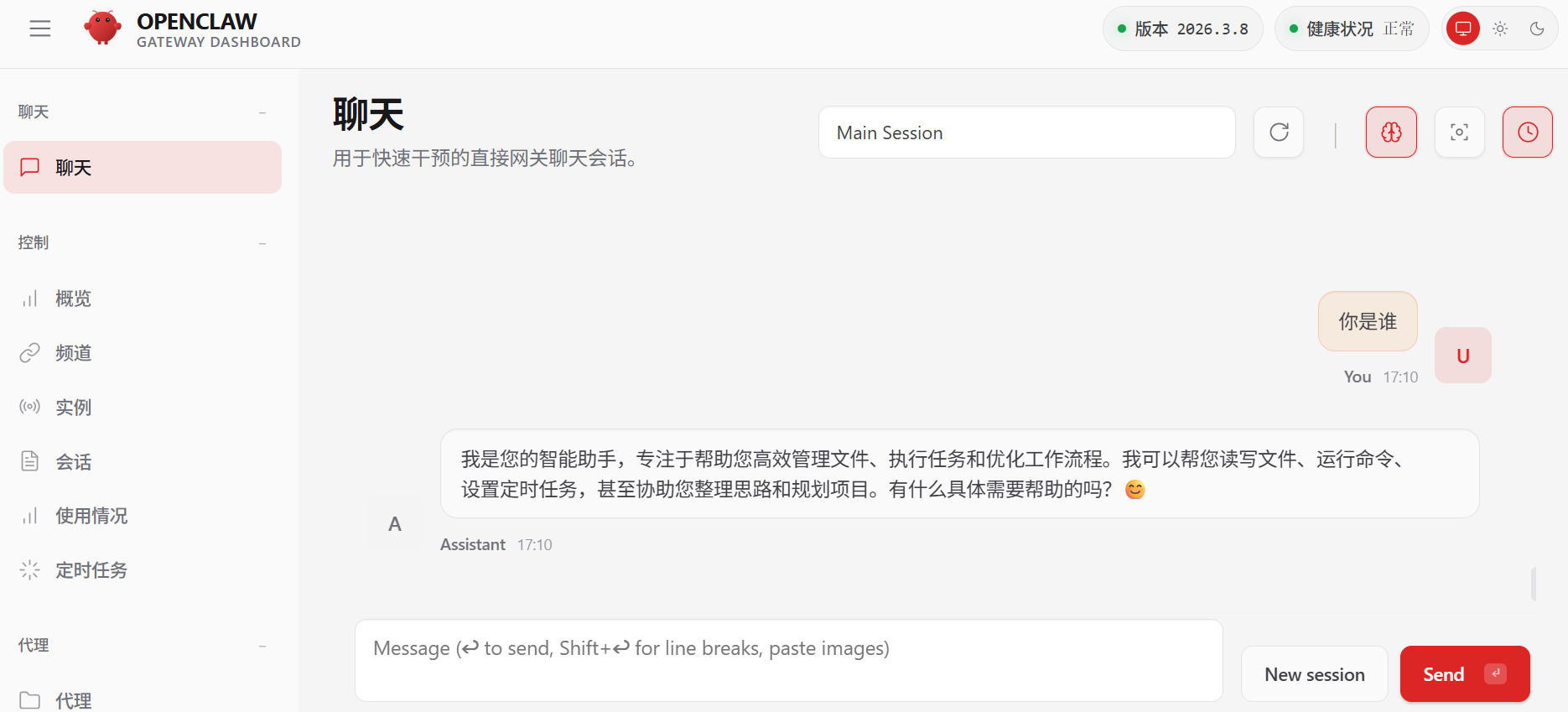

切换至“聊天”菜单项,即可在WebUI页面与OpenClaw应用进行对话,例如下图所示。

若存在安全风险,可自定义token值,只需确保步骤2与步骤3中的token保持一致即可。

飞书配置

-

返回飞书自建应用,单击导航栏的[权限管理]页签,点击“批量导入/导出权限”按钮,粘贴以下JSON配置,单击“下一步,确认新增权限”按钮,单击“申请开通”按钮,并“确认开启”所需权限。

{

"scopes": {

"tenant": [

"aily:file:read",

"aily:file:write",

"application:application.app_message_stats.overview:readonly",

"application:application:self_manage",

"application:bot.menu:write",

"cardkit:card:write",

"contact:user.employee_id:readonly",

"corehr:file:download",

"docs:document.content:read",

"event:ip_list",

"im:chat",

"im:chat.access_event.bot_p2p_chat:read",

"im:chat.members:bot_access",

"im:message",

"im:message.group_at_msg:readonly",

"im:message.group_msg",

"im:message.p2p_msg:readonly",

"im:message:readonly",

"im:message:send_as_bot",

"im:resource",

"sheets:spreadsheet",

"wiki:wiki:readonly"

],

"user": ["aily:file:read", "aily:file:write", "im:chat.access_event.bot_p2p_chat:read"]

}

} -

单击左侧导航栏[添加应用能力]页签,选择[按能力添加/机器人]Tab页,单击“配置”按钮即可。

-

单击左侧导航栏[事件与回调]页签,在[事件配置]页签中单击[订阅方式],选择[使用长连接接收事件],单击“保存”按钮。

配置文件保存后服务通常立即启动,但可能存在短暂延迟。若首次保存失败,请等待1分钟后重试。

-

在事件配置页面,单击“添加事件”按钮,搜索事件

im.message.receive_v1(接收消息),单击“确认添加”按钮,添加对应配置,例如下图所示。

-

参数配置完成后,在[版本管理与发布]页面创建版本,填写“应用版本号”和“更新说明”,单击“保存”,提交审核并发布该应用。

应用发布后通常无需人工审核,系统将自动上线。

-

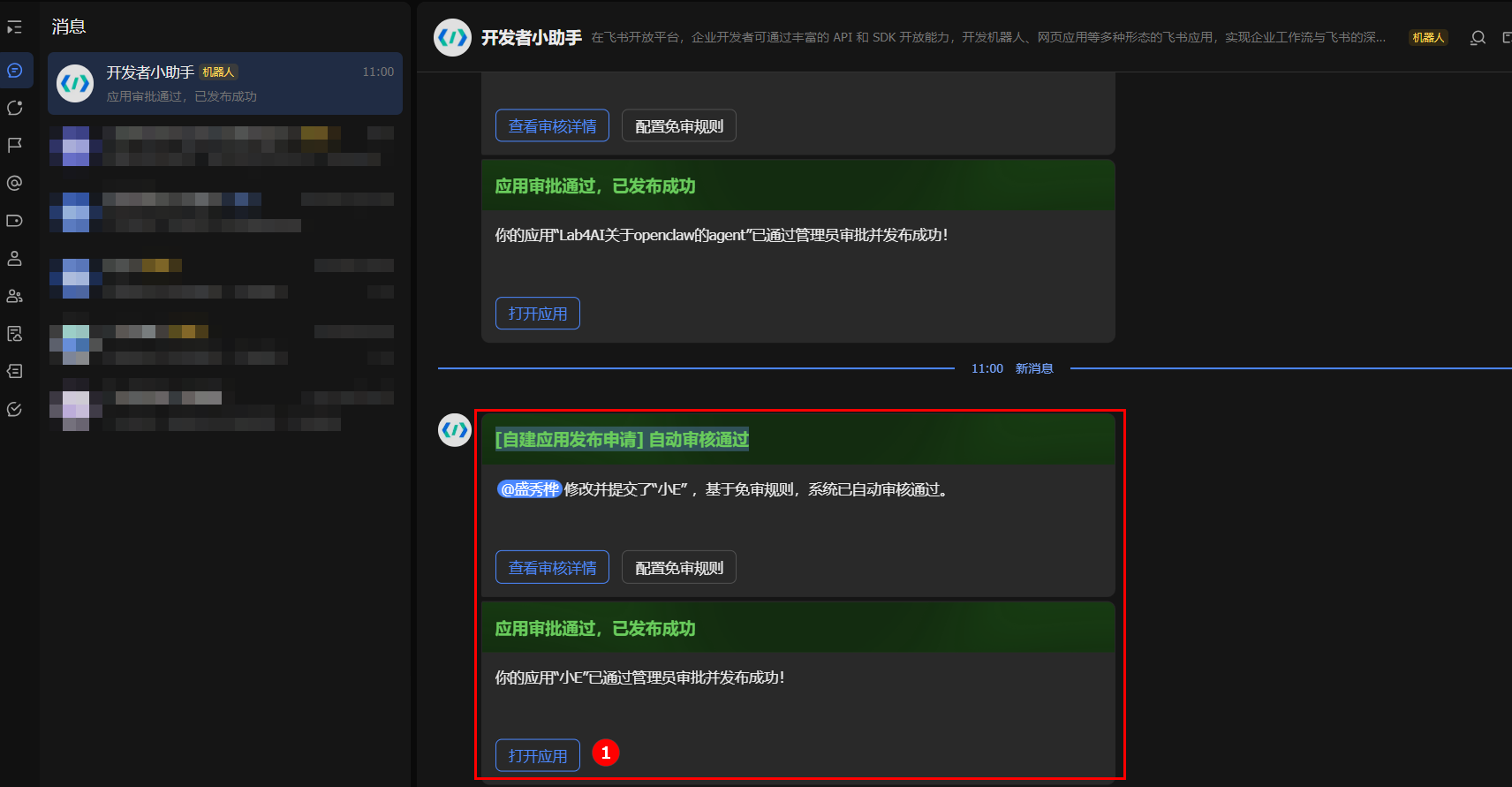

打开飞书客户端,开发小助手提醒“[自建应用发布申请]自动审核通过”并且应用已发布成功,例如下图所示。

-

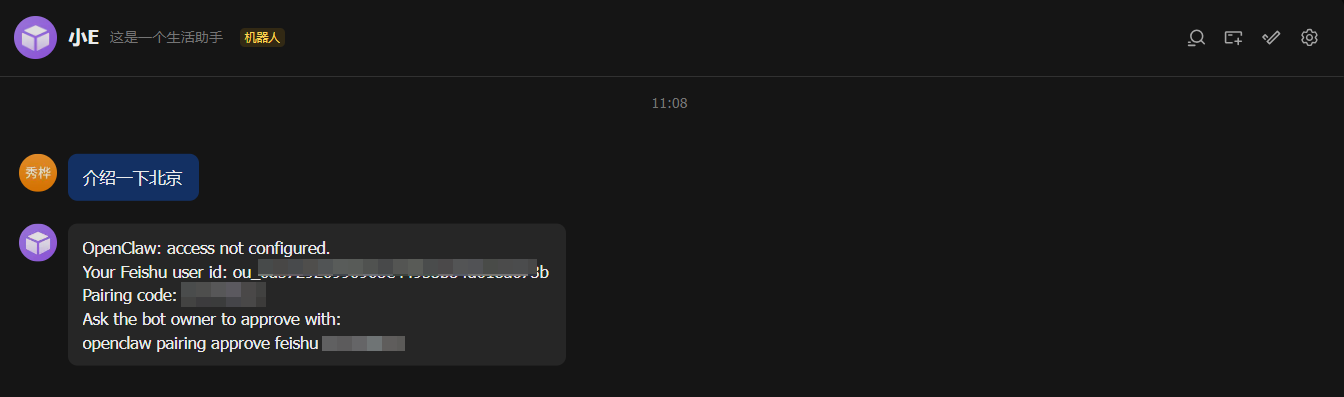

单击“打开应用”按钮,例如上图高亮①所示,进入与机器人进行对话窗口。向机器人发送一条消息,机器人会回复一个配对码。

-

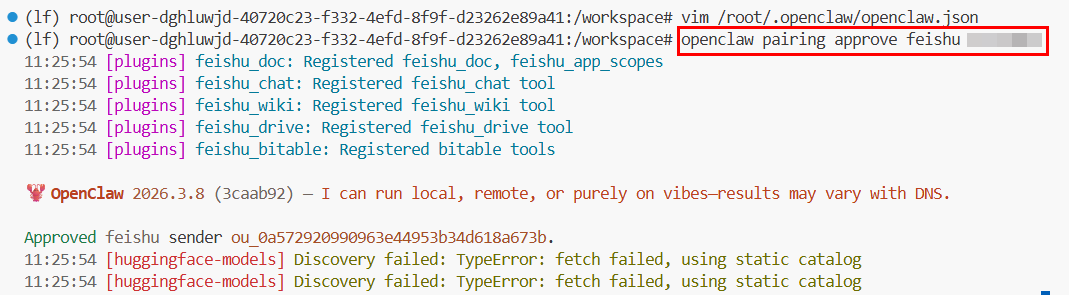

在大模实验室实例的终端页面运行

openclaw pairing approve feishu 配对码命令并回车,例如下图所示。

如果运行上述命令时,页面提示“bash:openclaw:command not found”,通常可以运行以下命令解决。

source ~/.profile

-

配对成功后,即可开始与Agent开始对话,例如下图所示。

大模型实验室实例停止时,关联应用将自动进入低功耗休眠状态,即时释放计算资源以节省成本;当实例再次启动,应用无缝恢复至中断前的运行状态并随即激活。灵活的应用管理不仅实现了资源的按需分配,更让您在保障业务连续性的同时,获得优质的管控体验。

常见问题

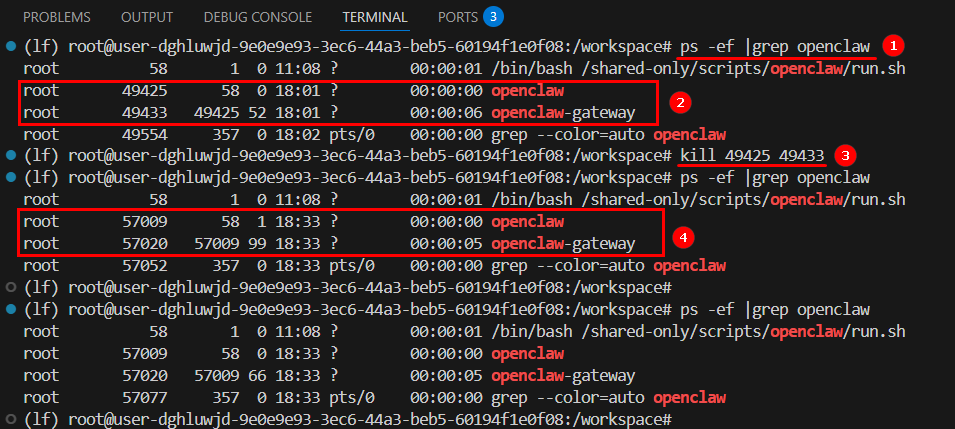

问题1:如何重启openclaw服务?

如果您想重启openclaw服务,可参考以下步骤完成操作。

-

在[New Terminal/Terminal]终端页面运行如下所示的命令,如下图高亮①所示,获取

openclaw的进程信息。ps -ef |grep openclaw -

执行

kill命令终止进程,如下图高亮③所示,随后该进程将自动重启,如下图高亮④所示,进程启动后标志着openclaw服务重启完成。kill <进程号>

总结

OpenClaw已深度适配大模型实验室环境,支持无缝部署。通过高度可定制的脚本配置引擎,灵活定义数据流与控制逻辑,实现与各类第三方应用及工具链的深度集成与自动化协同,从而构建起高效的大模型研发闭环。